Dataflows Power BI: zelfservice ETL voor business gebruikers

Power BI architect, LSS Black Belt. 15 jaar ervaring in data & business intelligence.

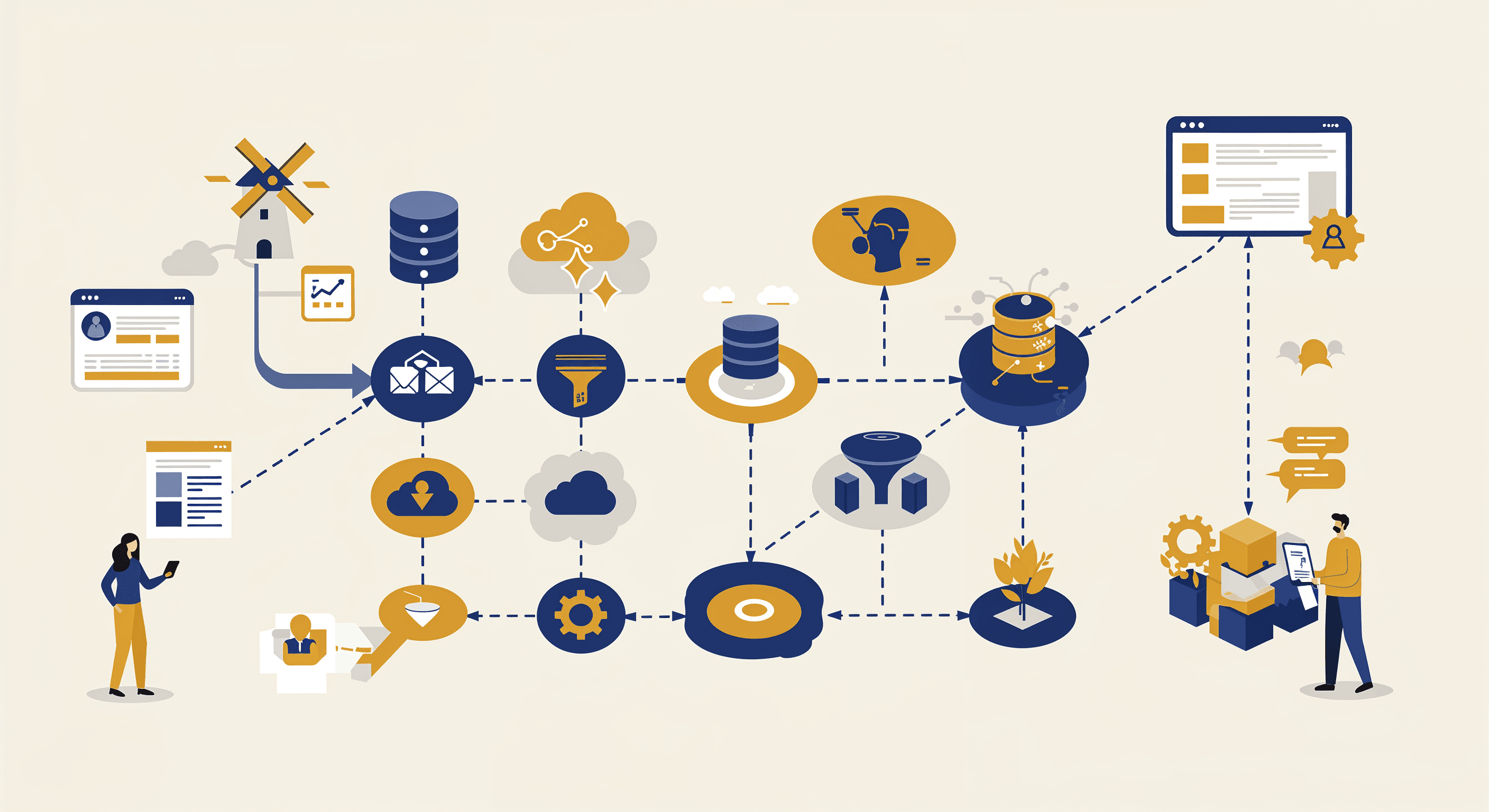

Power BI dataflows vormen de brug tussen complexe data-engineering en toegankelijke zelfservice analytics. Ze stellen business gebruikers in staat om zelf data op te schonen, te transformeren en voor te bereiden — zonder diepgaande technische kennis of afhankelijkheid van IT-teams. Voor CFO's en operations managers betekent dit snellere inzichten en meer autonomie in dataverwerking.

Een dataflow is in essentie een cloudgebaseerde ETL-oplossing die draait op Microsoft's dataverse-infrastructuur. Het combineert de kracht van Power Query (bekend van Excel) met de schaalbaarheid van de cloud, waardoor ook niet-technische gebruikers complexe datatransformaties kunnen uitvoeren.

Wat zijn Power BI dataflows precies?

Dataflows zijn herbruikbare verzamelingen van data-entiteiten die je kunt delen tussen verschillende Power BI datasets en rapporten. Denk aan ze als een gedeelde datakeuken waar ruwe ingrediënten (brondata) worden omgezet in kant-en-klare maaltijden (schone datasets).

Een typisch scenario: je finance-team haalt maandelijks data uit drie verschillende systemen — je ERP, CRM en Excel-bestanden van verschillende afdelingen. Normaal gesproken moet iemand handmatig deze data combineren, opschonen en structureren voordat analyses mogelijk zijn. Met dataflows automatiseer je dit proces volledig.

Kerncomponenten van dataflows

- Entiteiten: Tabellen met gestructureerde data uit verschillende bronnen

- Power Query-editor: Visual interface voor datatransformaties

- Dataverse-opslag: Cloudgebaseerde opslag voor getransformeerde data

- Refresh-scheduling: Automatische verversing van data op ingestelde tijden

- Computed entities: Berekende tabellen gebaseerd op andere entiteiten

Het verschil met traditionele ETL-tools is de low-code benadering. Je sleept, klikt en configureert in plaats van dat je code schrijft. Toch blijft de functionaliteit krachtig genoeg voor complexe transformaties.

Waarom zelfservice ETL cruciaal is voor moderne organisaties

De traditionele BI-architectuur creëert vaak een flessenhals bij IT-teams. Business gebruikers wachten weken op nieuwe datasets, wijzigingen in rapportages of oplossingen voor datakwaliteitsproblemen. Deze vertraging beperkt de wendbaarheid van organisaties in een snel veranderende markt.

Zelfservice ETL doorbreekt deze cyclus door business gebruikers direct controle te geven over hun dataverwerking. Een controller kan zelf bepalen hoe financiële data wordt geconsolideerd. Een operations manager kan direct nieuwe KPI-berekeningen implementeren zonder tickets bij IT.

Business voordelen van dataflows

De impact op organisatieniveau is meetbaar. Bij het GGDGHOR-project zagen we dat dataflows de doorlooptijd voor nieuwe rapporten reduceerden van gemiddeld 6 weken naar 3 dagen. Finance-teams kunnen nu binnen een dag ad-hoc analyses draaien die voorheen een maand kostten.

- Snellere time-to-insight: Van weken naar dagen voor nieuwe analyses

- Verminderde IT-dependency: 70% minder tickets voor dataverzoeken

- Consistente datakwaliteit: Eenmalig opgezette transformaties voor alle rapporten

- Herbruikbaarheid: Dezelfde dataflows voor meerdere dashboards en analyses

- Governance behoud: Centraal beheer van databronnen en toegang

Een concreet voorbeeld: een internationale retail-organisatie gebruikt dataflows om verkoopdata uit 50+ winkels te consolideren. Voorheen namen regionale managers Excel-bestanden door om trends te identificeren. Nu refreshen dataflows automatisch alle winkeldata, bereken ze vergelijkende KPI's en voeden ze real-time dashboards. Het resultaat: van 2 dagen handwerk per week naar 10 minuten monitoring.

Technische mogelijkheden en beperkingen

Dataflows bieden verrassend veel technische diepgang voor een zelfservice-tool. De onderliggende Power Query-engine ondersteunt honderden connectoren en transformaties. Je kunt complexe joins uitvoeren, berekende kolommen toevoegen, data pivoten en zelfs custom functies schrijven in M-code.

Ondersteunde databronnen

Microsoft dataflows connecteren met vrijwel elke moderne databron:

- Cloud databases: Azure SQL, Amazon RDS, Google BigQuery

- On-premises systemen: SQL Server, Oracle, SAP via on-premises gateway

- Webservices: REST API's, OData feeds, SharePoint lijsten

- Bestanden: Excel, CSV, JSON, Parquet files

- SaaS-applicaties: Salesforce, Dynamics 365, ServiceNow

Een belangrijk voordeel is de incremental refresh functionaliteit. Voor grote datasets kun je instellen dat alleen nieuwe of gewijzigde records worden verwerkt, wat de performance en kosten drastisch verbetert.

Beperkingen om rekening mee te houden

Dataflows zijn krachtig, maar niet alles-overkoepelend. Belangrijke beperkingen:

- Performance-limieten: Grote datasets (>1GB) kunnen traag refreshen

- Geen real-time processing: Minimum refresh-interval is 15 minuten

- Beperkte foutafhandeling: Minder robuust dan professionele ETL-tools

- Licentiekosten: Premium-features vereisen Power BI Premium of Premium Per User

Voor high-volume scenarios of complexe real-time processing blijven traditionele ETL-tools zoals Azure Data Factory of SSIS relevanter. Azure data platform opzetten zonder ruis geeft meer context over wanneer je voor welke technologie kiest.

Praktische implementatie: stap voor stap

Een dataflow implementeren begint met het identificeren van de juiste use case. Ideaal zijn scenario's met:

- Regelmatige, voorspelbare datatransformaties

- Meerdere rapporten die dezelfde geprocessede data gebruiken

- Business gebruikers die zelf wijzigingen willen doorvoeren

- Databronnen die stabiel zijn in structuur

Opzetten van je eerste dataflow

Het proces begint in de Power BI Service. Ga naar een workspace, kies 'New' en selecteer 'Dataflow'. Je wordt geleid door een wizard die veel lijkt op Power Query in Power BI Desktop.

Stap 1: Databronnen selecteren

Begin met het kiezen van je primaire databron. Voor dit voorbeeld gebruiken we een combinatie van Excel-bestanden (budgets) en een SQL Server database (actuele cijfers).

Stap 2: Data shaping

Hier gebeurt de magie. Gebruik de Power Query-editor om:

- Kolommen te hernoemen naar consistente naming conventions

- Data types te standardiseren

- Onnodige rijen te filteren

- Berekende kolommen toe te voegen

- Tabellen te combineren via joins of appends

Stap 3: Entiteiten definiëren

Elke tabel in je dataflow wordt een entiteit. Geef ze logische namen die business gebruikers begrijpen: 'Sales_Clean', 'Budget_Consolidated', 'KPI_Calculations'.

Stap 4: Refresh-schema instellen

Bepaal hoe vaak data moet worden ververst. Voor financiële rapportages is dagelijks vaak voldoende, voor operationele dashboards misschien elk uur.

Best practices voor dataflow-ontwerp

Succesvolle dataflows volgen enkele ontwerpprincipes die de onderhoudbaarheid en performance waarborgen:

- Modulaire opbouw: Splits complexe transformaties op in meerdere entiteiten

- Duidelijke naming: Gebruik bedrijfsterminologie, geen technische codes

- Documentatie: Voeg beschrijvingen toe aan entiteiten en complexe stappen

- Error handling: Bouw tolerantie in voor ontbrekende data of structuurwijzigingen

- Performance monitoring: Houd refresh-tijden bij en optimaliseer waar nodig

Een veelgemaakte fout is het maken van één grote, allesomvattende dataflow. Dit wordt onbeheersbaar en traag. Beter is het om dataflows te organiseren rond business domeinen: één voor sales, één voor finance, één voor HR.

Dataflows vs traditionele ETL-tools

De keuze tussen dataflows en traditionele ETL-tools hangt af van je organisatiecontext. Beide hebben hun plaats in moderne data-architecturen.

Wanneer dataflows de juiste keuze zijn

Dataflows excelleren in scenario's met:

- Business-driven analytics: Wanneer eindgebruikers zelf controle willen

- Matige complexiteit: Standaard transformaties zonder extreem complexe logica

- Snelle iteratie: Requirements die regelmatig wijzigen

- Limited IT resources: Kleine teams die niet kunnen investeren in dedicated ETL-infrastructuur

Bij Lyreco implementeerden we dataflows voor hun Benelux finance-rapportages. Het finance-team kon zelf budgetcategorieën aanpassen, nieuwe cost centers toevoegen en KPI-berekeningen wijzigen — allemaal zonder involvement van IT. Dit reduceerde de doorlooptijd voor management-rapportages van 2 weken naar 2 dagen.

Wanneer traditionele ETL superieur is

Voor bepaalde scenario's blijven tools zoals Azure Data Factory, SSIS of Informatica de betere keus:

- Extreme volumes: Multi-terabyte datasets die parallel processing vereisen

- Real-time requirements: Sub-seconde latency voor operationele systemen

- Complexe business logic: Algoritmes die custom coding vereisen

- Enterprise governance: Strenge compliance-eisen met uitgebreide audit trails

Een hybride aanpak werkt vaak het best. ETL proces automatiseren met Python toont hoe je beide werelden kunt combineren.

Governance en beveiliging van dataflows

Zelfservice betekent niet ongecontroleerd. Succesvolle dataflow-implementaties hebben heldere governance-structuren die autonomie combineren met controle.

Toegangsbeheer en security

Power BI dataflows erven het beveiligingsmodel van de workspace waarin ze staan. Dit betekent dat je op workspace-niveau kunt bepalen wie dataflows mag maken, bewerken of gebruiken.

Voor gevoelige data is row-level security cruciaal. Je kunt RLS implementeren op dataflow-niveau, wat vervolgens doorwerkt naar alle dashboards die de dataflow gebruiken. Row Level Security Power BI: complete implementatiegids voor enterprise beveiliging geeft diepgaande uitleg over deze implementatie.

Een praktijkvoorbeeld: een zorgorganisatie gebruikt dataflows voor patiëntgegevens. Door RLS in te stellen op de dataflow-entiteiten zien artsen alleen hun eigen patiënten, managers alleen hun afdeling, en directie alleen geaggregeerde cijfers — allemaal vanuit dezelfde databron.

Change management en versioning

Dataflows missen native versioning, wat uitdagingen creëert voor change management. Best practices:

- Naming conventions: Gebruik versienummers in dataflow-namen voor majeure wijzigingen

- Test-omgevingen: Ontwikkel in aparte workspaces voordat je naar productie gaat

- Documentation: Houd een changelog bij van wijzigingen en impact

- Backup strategies: Export kritieke dataflows regelmatig

Performance optimalisatie en kostenbeheer

Dataflows kunnen kostbaar worden als ze niet goed beheerd worden. Performance-optimalisatie is direct gekoppeld aan kostenbeheer in cloud-omgevingen.

Refresh-strategieën

De refresh-frequentie is de grootste kostenfactor. Elke refresh kost compute-tijd en opslag. Optimalisatiestrategieën:

- Differential refresh: Alleen gewijzigde data verwerken

- Time-based filtering: Alleen relevante datumranges ophalen

- Computed entities: Zware berekeningen één keer doen, resultaat hergebruiken

- Refresh scheduling: Spreidt refreshes over de dag om piekmomenten te vermijden

Bij een logistics-bedrijf optimaliseerden we hun dataflows door shipment-data incrementeel te refreshen. In plaats van elke dag alle 2 miljoen records opnieuw te verwerken, refreshen ze alleen records van de laatste 7 dagen. Dit reduceerde refresh-tijd van 4 uur naar 20 minuten.

Monitoring en alerting

Proactieve monitoring voorkomt dat dataflow-problemen doorwerken naar business-kritieke dashboards. Belangrijke metrics:

- Refresh duration: Plots stijgende refresh-tijden duiden op performance-problemen

- Failure rates: Hoge faalpercentages vragen om robuustere error handling

- Data volume trends: Snelgroeiende datasets kunnen capacity-upgrades vereisen

- Usage patterns: Welke entiteiten worden wel/niet gebruikt?

Microsoft biedt beperkte native monitoring. Voor enterprise-toepassingen investeren organisaties vaak in third-party monitoring tools of custom PowerShell-scripts die refresh-status monitoren.

Integratie met Microsoft Fabric

Microsoft Fabric verandert het dataflow-landschap fundamenteel. Fabric dataflows (Gen2) bieden significant meer mogelijkheden dan traditionele Power BI dataflows.

Nieuwe mogelijkheden in Fabric

Fabric introduceert Data Factory-integratie, waardoor dataflows kunnen communiceren met pipelines, notebooks en andere Fabric-workloads. Dit opent nieuwe architectuurpatronen:

- Pipeline orchestration: Dataflows als onderdeel van complexere workflows

- Lakehouse integration: Directe output naar OneLake zonder tussenstappen

- Real-time analytics: Kombinatie met Fabric's streaming capabilities

- AI integration: Native machine learning-functies in Power Query

Microsoft Fabric implementatie die werkt bespreekt de strategische overwegingen voor Fabric-migraties.

Migratiepad naar Fabric

Bestaande Power BI dataflows migreren naar Fabric vereist planning. De functionaliteit is grotendeels backward-compatible, maar de architectuur verschilt significant:

- Workspace-model: Fabric gebruikt andere governance-structuren

- Licentieverschillen: Fabric heeft andere capacity-modellen

- Performance characteristics: Fabric kan sneller zijn, maar gedraagt zich anders

Een gefaseerde migratie werkt het beste: begin met niet-kritieke dataflows, test grondig, en migreer productie-workloads pas na volledige validatie.

ROI en business case voor dataflows

De business case voor dataflows is meestal sterk, maar vereist zorgvuldige calculatie van zowel kosten als baten.

Kostenfactoren

De belangrijkste kostenposten:

- Licentiekosten: Premium capacity of Premium Per User subscripties

- Ontwikkeltijd: Initiële setup en ongoing maintenance

- Training: Business gebruikers opleiden in Power Query

- Change management: Organisatorische verandering begeleiden

Voor een typische mid-size organisatie (500+ employees) liggen de jaarlijkse kosten tussen €15.000-50.000, afhankelijk van het aantal gebruikers en data-volume.

Meetbare baten

De baten zijn vaak een veelvoud van de kosten:

- Tijd besparing: 60-80% reductie in tijd voor datavoorbereiding

- IT-ontlasting: 50-70% minder dataverzoeken bij IT-teams

- Snellere besluitvorming: Van weken naar dagen voor nieuwe inzichten

- Consistentie: Eliminatie van Excel-hell en handmatige fouten

Bij een productie-bedrijf berekenden we dat dataflows €180.000 per jaar besparen door geautomatiseerde rapportages. Het finance-team besteedt nu 12 uur per maand aan datavoorbereiding in plaats van 60 uur. Die vrijgekomen tijd wordt gebruikt voor analyse en strategische activiteiten.

Soft benefits

Moeilijker meetbare maar evenzo belangrijke voordelen:

- Employee satisfaction: Minder frustratie over trage dataprocessen

- Agility: Sneller inspelen op marktveranderingen

- Innovation: Business gebruikers kunnen experimenteren met nieuwe analyses

- Governance: Betere datakwaliteit en compliance

Praktijkcases en lessons learned

Echte implementaties leren ons meer dan theoretische modellen. Hier zijn concrete ervaringen uit verschillende sectoren.

Case: Finance-rapportage bij internationale retailer

Een modeketen met 200+ winkels worstelde met maandelijkse consolidatie. Elk land leverde Excel-bestanden met verschillende formaten, valuta's en productcategorieën. De consolidatie kostte het finance-team 2 weken per maand.

Met dataflows bouwden we een geautomatiseerde pipeline:

- Land-specifieke dataflows normaliseren lokale Excel-inputs

- Currency-conversie gebeurt automatisch via web-APIs

- Product mapping via lookup-tabellen die business users zelf onderhouden

- Consolidated entiteit combineert alle landen tot één dataset

Resultaat: van 2 weken naar 2 dagen voor maandafsluiting. Het team besteedt nu tijd aan analyse in plaats van datamanipulatie.

Case: Operationele dashboards bij logistics-provider

Een transportbedrijf wilde real-time inzicht in route-efficiency en chauffeur-performance. Data kwam uit verschillende systemen: GPS-tracking, fuel management, customer portals.

Uitdagingen waren:

- Verschillende data-formats en update-frequenties

- Chauffeur-privacy regelgeving

- Performance-requirements voor operational dashboards

De oplossing combineerde dataflows met traditionele ETL:

- Dataflows voor business logic en KPI-berekeningen

- Azure Data Factory voor high-frequency GPS-data

- Computed entities voor dashboard-ready aggregaties

Het hybride model geeft zowel performance als flexibiliteit. Operations managers kunnen zelf nieuwe KPI's definiëren, terwijl IT de data-infrastructure beheert.

Lessons learned

Succesvolle dataflow-implementaties delen gemeenschappelijke succesfactoren:

- Start klein: Begin met één business domain, bewijs waarde, schaal daarna uit

- Investeer in training: Power Query heeft een leercurve — ondersteun je business gebruikers

- Design for change: Business requirements wijzigen — maak je dataflows modulair en onderhoudbaar

- Monitor proactief: Failing dataflows breken business-kritieke dashboards

- Plan governance: Wie mag wat, wanneer en hoe? Regel dit vooraf

Een veel voorkomende valkuil is het onderschatten van data governance. Waarom worden dashboards niet gebruikt? laat zien hoe technische oplossingen falen zonder juiste organisatorische embedding.

Samenvatting

Power BI dataflows democratiseren ETL door geavanceerde data-transformaties toegankelijk te maken voor business gebruikers. Ze vormen de ideale brug tussen IT-gecontroleerde data-infrastructuur en business-gedreven analytics.

De belangrijkste voordelen zijn duidelijk: drastisch snellere time-to-insight, verminderde IT-dependency, en herbruikbare data-assets die consistency waarborgen. Voor mid-size tot grote organisaties kan een dataflow-implementatie tienduizenden euro's per jaar besparen aan operational efficiency.

Succesvol implementeren vereist echter meer dan technische skills. Governance-frameworks, change management, en goede training zijn net zo cruciaal als de technische architectuur. Power BI readiness scan: wat levert het op? helpt organisaties hun volwassenheid te beoordelen.

Met Microsoft Fabric wordt het dataflow-ecosysteem nog krachtiger. De integratie met lakehouse-architecturen en real-time analytics opent nieuwe mogelijkheden voor moderne data-platforms. Organisaties die nu investeren in dataflow-capabilities positioneren zich goed voor de AI-gedreven toekomst van business intelligence.

De fundamentele vraag is niet of dataflows nuttig zijn, maar hoe je ze optimaal inzet binnen je specifieke organisatiecontext. Start met een pilot, bewijs de waarde, en schaal systematisch uit. De return on investment is vrijwel gegarandeerd als je het goed aanpakt.